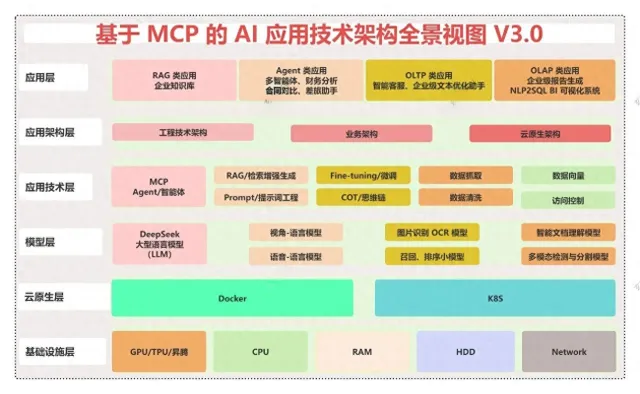

MCP平台已成为行业标杆,基于这一标准的人工智能技术正在各行业场景中开花结果。本文将系统剖析MCP平台支持的AI技术架构全景图,带您逐层了解:从基础设施、云原生支持、核心模型技术,到上层应用架构和实际落地场景。我们将揭示这个体系如何通过各层级的协同配合,将AI技术转化为实际的产业价值。

一、基础设施层:AI大模型的硬件基石

I大模型的训练与推理高度依赖底层硬件设施,这些组件共同构成了AI计算的物理基础:

1. GPU(图形处理单元)

核心作用:加速深度学习训练和推理,尤其擅长并行计算(如矩阵运算)。

典型应用:神经网络训练、大规模数据处理(视觉、自然语言任务)。

优势:相比CPU,在处理密集型计算时效率可提升数十倍。

2. CPU(中央处理单元)

核心作用:承担通用计算任务,如逻辑控制、任务调度和轻量级推理。

典型应用:AI服务的请求处理、系统资源管理、非并行化任务。

补充角色:即使在GPU密集型场景中,CPU仍负责协调整体计算流程。

3. RAM(随机存取存储器)

核心作用:提供高速临时存储,确保CPU/GPU快速访问当前计算所需的数据。

关键影响:

训练阶段:缓存小批量训练数据,减少I/O延迟。

推理阶段:存储模型参数(如大模型的部分权重),加速响应。

瓶颈:大模型参数规模可能远超RAM容量(如Llama3-70B需超140GB RAM),需依赖优化技术(如分片加载)。

4. HDD/SSD(存储设备)

核心作用:长期存储海量训练数据、模型检查点及日志文件。

技术选型:

HDD:低成本大容量,适合冷数据存储。

SSD:高速读写,适用于高频访问场景(如分布式训练的数据加载)。

挑战:超大规模数据集(TB级)可能引发存储带宽瓶颈,需结合分布式文件系统(如Ceph、HDFS)。

5. Network(网络设施)

核心作用:连接分布式计算节点,实现数据同步、模型并行等协作。

关键需求:

高带宽:支持节点间快速传输模型参数(如All-Reduce操作)。

低延迟:减少跨节点通信对训练速度的影响。

典型方案:

数据中心内:InfiniBand/RDMA(超低延迟)。

跨区域:高速专线+压缩技术(如梯度压缩)。

基础设施的协同运作

在AI任务中,这些硬件设施形成紧密协作的链条:

训练阶段:

GPU集群执行核心计算,CPU协调任务调度。

RAM缓存数据,SSD/HDD提供持久化存储。

Network同步参数,确保分布式训练一致性。

推理阶段:

GPU/CPU根据负载分配计算(如GPU处理高并发请求,CPU处理轻量任务)。

RAM加速模型加载,SSD存储热模型。

优化方向

硬件适配:针对不同场景选择组件组合(如训练侧重GPU+高速网络,边缘推理侧重低功耗CPU+NPU)。

瓶颈突破:通过FP8量化、模型分片等技术减少对单一资源的依赖(如降低显存占用)。

这一基础设施层是AI技术落地的物理承载,其性能与成本直接影响模型的开发效率和部署可行性。

二、云原生层

弹性伸缩层: 基于Docker容器和K8S的弹性云原生架构,为AI大模型的预训练、微调、推理以及AI应用的部署,提供了高扩展、高可用的云环境,从而根据访问量的情况动态伸缩。

三、模型层

大语言模型(LLMs)

大语言模型的运用大语言模型,比如DeepSeek R1,具备处理及生成自然语言文本的能力。这些模型通过海量训练数据学习语言规律,能够执行包括文本创作、翻译、摘要在内的多种自然语言处理任务。

视觉-语言模型的融合

视觉-语言模型结合了视觉与语言信息,能够理解和创造跨模态内容。这种模型不仅能够处理文字信息,还能识别和生成图像、视频等视觉内容,广泛应用于图像标注、视频解析等领域。

智能文档理解的实现

智能文档理解技术通过解析文本和非结构化数据,实现对文档内容的深入理解。它能够自动抓取关键信息,执行文档的分类和提炼工作,从而为文档管理及信息检索提供智能化支持。

多模态检测与分类的技术

多模态检测与分类技术整合了多种数据类型,以实现更精确的分类和检测。通过融合文本、图像、音频等多种模态的信息,该技术提升了模型的精确度和稳健性,并在安全监控、医疗诊断等多个领域得到了广泛应用。

四、应用技术层

MCP 技术

MCP(Model Context Protocol)是由Anthropic公司提出的一种协议,旨在解决不同大语言模型(LLM)与不同外部工具集成的标准化问题。通过MCP,开发者能够以一种统一的方式将各种数据源和工具连接到AI大模型,从而提升大模型的实用性和灵活性。

-ptJG.png)

目前,MCP 生态已有众多主流 AI 模型加入,包括 Anthropic 的 Claude 系列、OpenAI 的 GPT 系列、Meta 的 Llama 系列、DeepSeek、阿里的通义系列以及 Anysphere 的 Cursor 等。MCP 已成为连接不同 AI 模型和应用工具的关键桥梁,使其能够在统一框架下协同工作。

MCP 架构设计:连接 AI 与现实数据

MCP 采取了客户端-服务器架构,确保 AI 模型能够访问和操作各类数据源(本地文件、数据库、API 等)。该架构包含以下核心组件:

.png)

1. MCP 主机(Hosts)

角色:AI 应用的入口,如 Claude Desktop、IDE 或其他 AI 集成工具。

功能:作为用户与 AI 模型之间的交互界面,负责发起请求并展示 AI 生成的内容。

2. MCP 客户端(Clients)

角色:负责与 MCP 服务器建立 1:1 连接。

功能:处理通信协议,确保数据在主机与服务器之间高效、准确地传输。

3. MCP 服务器(Servers)

角色:轻量级程序,通过标准化的协议暴露特定功能。

功能:连接 AI 模型与各类数据源(文件、API、数据库等),使大模型能够读取和操作实际数据,从而增强 AI 的实用性。

数据源支持

本地数据:如本地文件、数据库,MCP 服务器可安全访问。

远程服务:如外部 API,MCP 服务器可以连接这类系统,拓展 AI 的应用场景。

Agent(智能体)技术:让 AI 自主完成任务

Agent 技术利用大模型的推理能力,将复杂任务拆解成多个子步骤,并调用外部工具(如数据库查询、API 调用、自动化脚本等)逐步执行,最终完成目标。

例如,一个金融数据分析 Agent可以做以下事情:

任务解析:理解用户需求(如“分析某公司的近五年财报”)。

数据获取:自动查询数据库或 API 获取财务数据。

数据处理:调用 Python 脚本进行数据清洗和计算。

结果生成:让模型总结趋势,生成报告。

Agent 技术极大提升了 AI 的自动化水平,使其不仅能回答问题,还能真正“做事”。

.png)

RAG(检索增强生成)技术:提升信息精准度

RAG 技术结合了信息检索与内容生成的优势。当模型回答问题时,会先从结构化或非结构化数据源(如数据库、文档库)中检索相关内容,再基于这些信息生成准确、可靠的答案。这种方法显著减少了模型凭空臆测的风险,适用于知识密集型任务(如问答系统、智能客服)。

大模型微调(Fine-tuning):任务优化的关键手段

通用大语言模型虽然具备广泛的知识,但在特定任务(如法律分析、医疗问答)上可能表现不够精准。微调技术通过在特定领域的数据集(如专业文献、行业报告)上调整模型参数,使其更符合业务需求。常见的微调方式包括:

全面微调(Full Fine-tuning):调整整个模型

轻量化微调(LoRA/QLoRA):仅优化部分参数,减少计算开销

提示词工程(Prompt Engineering):高效引导模型输出

模型的生成质量很大程度上依赖于输入指令的质量。提示词工程通过优化输入格式(如Few-shot示例、指令增强、思维链提示),使模型输出的内容更贴合实际需求。该技术广泛用于减少无关回复、提高任务完成率。

思维链(Chain-of-Thought)技术:强化逻辑推理能力

传统AI模型可能直接输出结论,而思维链技术要求模型“展示推理过程”,如“分析问题→分解步骤→逐步求解”。这种方法不仅能提高复杂问题(数学计算、逻辑推理)的准确性,还使模型决策更透明、易解释。

数据工程技术:AI落地的核心支撑

AI应用的数据处理流程包括多个关键环节:

数据采集:爬取网页、API调用、日志收集

数据清洗:去噪、格式标准化、标注

向量化处理:构建向量库以支持检索(如RAG)

访问控制:确保数据合规与隐私保护

这些环节直接影响模型训练的可靠性和生产部署的稳定性。

五、应用架构层

工程技术架构

高可用:分布式部署、容灾备份

高性能:缓存优化、并行计算

高可靠:数据校验、异常监控

业务架构

根据场景需求选择不同架构:

RAG架构:适用于知识密集型问答

Agent架构:适合自动化工作流

混合架构:结合多种技术(如RAG + Agent)

云原生架构

弹性伸缩:基于K8S的动态扩缩容

成本优化:按需分配计算资源

六、应用层

增量应用(新型AI落地场景)

RAG类:智能客服、知识库助手

Agent类:自动化流程(如数据分析、报告生成)

存量应用(AI赋能传统系统)

OLTP类:交易流水分析、实时风控

OLAP类:商业智能报表、数据仓库增强

.png)

评论区